Mensch-KI-Zusammenarbeit in der Recherche: Wie Analysten und KI-Agenten gemeinsam bessere Insights liefern

Wer heute "Mensch-KI-Zusammenarbeit" googelt, bekommt Erklärungen wie aus einem HR-Seminar: KI übernimmt die Routine, der Mensch bringt Kreativität und Empathie. Salesforce listet zehn Skills auf. Workday redet über Trends. Die Tagesschau fragt, ob Agenten Menschen brauchen. IBP Akademie erklärt Kollaborative Intelligenz.

Alle reden über Zusammenarbeit. Niemand erklärt, wie sie in der Praxis funktioniert, zumindest nicht dort, wo sie den größten Hebel hat: in der strategischen Recherche und Analyse.

Mensch-KI-Zusammenarbeit heißt nicht, dass ChatGPT Ihnen eine E-Mail formuliert. Es heißt, dass KI-Agenten Ihre Recherchearbeit ausführen, während Sie sich auf Interpretation und Entscheidung konzentrieren. Dieser Unterschied wird in der aktuellen Debatte konsequent ignoriert.

Warum die aktuelle Diskussion am Kern vorbeiredet

Die Forschung ist sich einig: Mensch-KI-Teams können besser arbeiten als Mensch oder KI allein. Eine Studie der Max-Planck-Gesellschaft zeigt, dass hybride Mensch-KI-Kollektive in der medizinischen Diagnostik genauere Ergebnisse liefern als Ärzte oder KI-Systeme isoliert. Das Stanford HAI berichtet von 10-50% Produktivitätssteigerung in Bereichen wie Softwareentwicklung und Datenverarbeitung.

Aber schauen Sie sich an, welche Anwendungsfälle diskutiert werden:

| Quelle | Empfohlener Use Case |

|---|---|

| Salesforce | Kundenservice, CRM-Automatisierung |

| Workday | HR-Prozesse, Employee Experience |

| IBP Akademie | Allgemeine Wissensarbeit, generisch |

| FlowHunt | Routine-Automatisierung, Kreativitäts-Support |

| WEF | Arbeitsplatzgestaltung, Skill-Entwicklung |

Immer dasselbe Muster. KI für Routine, Mensch für Kreativität. Klingt logisch, ist aber zu abstrakt, um jemandem bei der Arbeit zu helfen. Kein einziger Beitrag im deutschsprachigen SERP erklärt, wie die Zusammenarbeit konkret aussieht, wenn ein Analyseteam eine Wettbewerbslandschaft kartiert oder eine Due Diligence vorbereitet.

Genau da liegt die Lücke.

Was Mensch-KI-Zusammenarbeit in der Recherche bedeutet

In der strategischen Recherche heißt Mensch-KI-Zusammenarbeit nicht "KI beantwortet Fragen". Es heißt: KI-Agenten führen den Recherche-Workflow aus, Menschen bewerten die Ergebnisse und treffen die Entscheidungen.

McKinseys State of AI Report 2025 zeigt das Problem in Zahlen: 88% der Unternehmen nutzen KI in mindestens einer Funktion, aber nur 1% hält sich für reif genug, um echten Wert daraus zu ziehen. BCG berichtet, dass 60% der Unternehmen keinen messbaren Nutzen aus ihren KI-Investitionen ziehen. Die DeepL-Studie von Ende 2025 ergab, dass 69% der Führungskräfte tiefgreifende Veränderungen durch KI-Agenten erwarten, aber die meisten nicht wissen, wo sie anfangen sollen.

Das Problem ist nicht die Technologie, sondern dass die meisten Unternehmen KI als Feature einsetzen statt als Arbeitskollegen. Der Analyst öffnet ChatGPT, stellt eine Frage, bekommt eine Antwort, kopiert sie in sein Dokument. Das ist Nutzung, keine Zusammenarbeit.

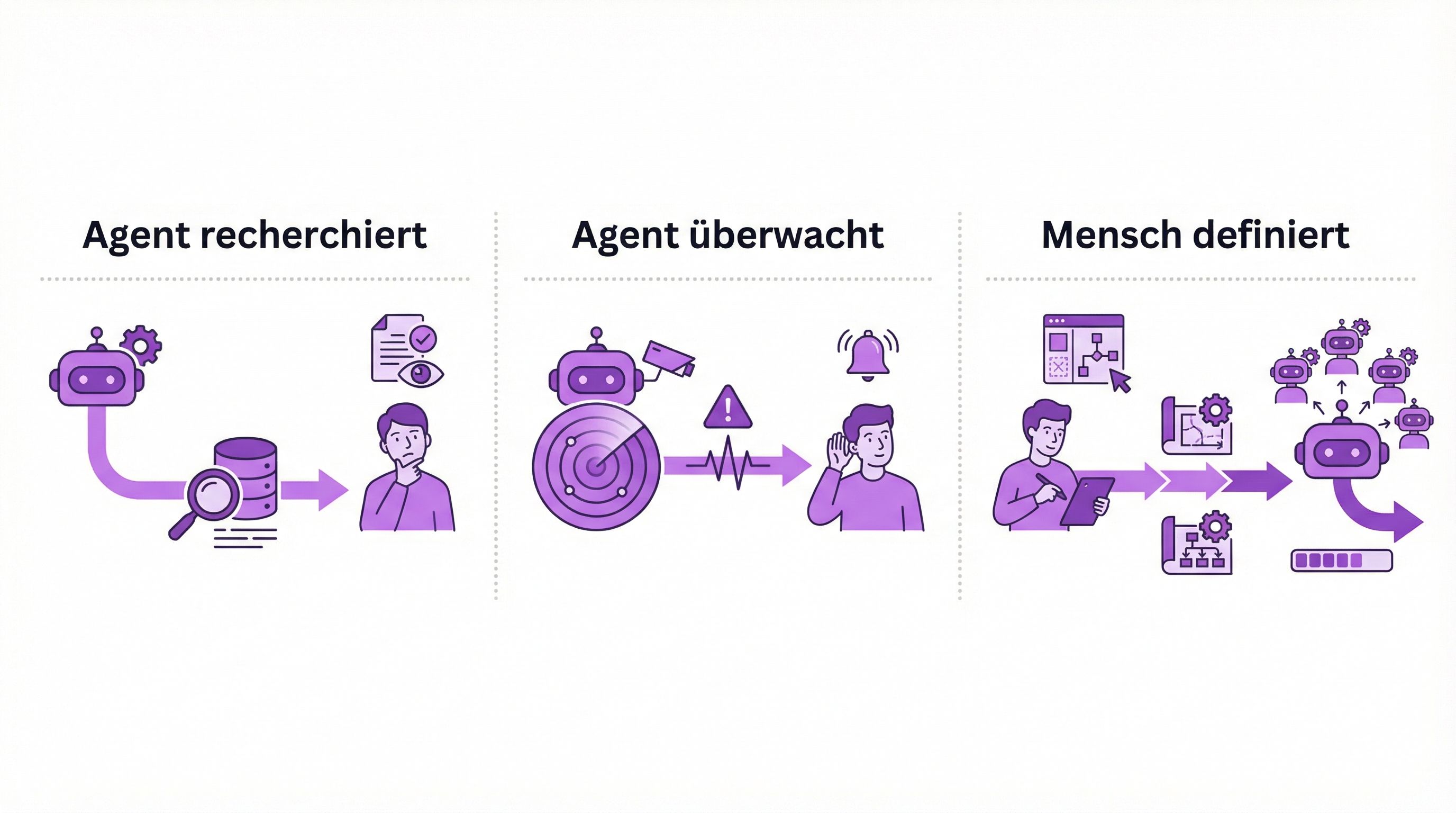

Echte Zusammenarbeit sieht anders aus. Drei Arbeitsmodi haben sich in der Praxis bewährt:

Modus 1: Agent recherchiert, Mensch bewertet

Der KI-Agent bekommt ein Rechercheziel, zum Beispiel: "Identifiziere alle Startups im Bereich Festkörperbatterie, die seit Q3 2025 eine Finanzierung über 5 Mio. Euro erhalten haben". Er durchsucht parallel mehrere Datenbanken, filtert, clustert und liefert ein strukturiertes Ergebnis mit Quellenangaben. Der Analyst prüft die Qualität, bewertet die strategische Relevanz und zieht Schlüsse, die der Agent nicht ziehen kann, weil ihm der organisationale Kontext fehlt.

Das ist der häufigste Modus. Er spart nicht nur Zeit, er verbessert die Abdeckung, weil der Agent systematischer sucht als ein Mensch unter Zeitdruck.

Modus 2: Agent überwacht, Mensch reagiert

Der Agent monitort kontinuierlich definierte Signale: neue Patentanmeldungen in einem Technologiefeld, regulatorische Änderungen, Führungswechsel bei Wettbewerbern, Finanzierungsrunden relevanter Startups. Wenn ein Signal eine Schwelle überschreitet, alertet er den Analysten. Nicht als generischer Newsletter, sondern kontextualisiert im Rahmen des laufenden Projekts.

Atlassians AI Collaboration Report zeigt, warum das zählt: Strategische KI-NutzerInnen erzielen den doppelten ROI gegenüber reinen AnwenderInnen. Bis 2026 soll der Faktor auf 4x steigen. Der Unterschied liegt nicht im Tool, sondern darin, ob jemand die KI als passives Werkzeug oder als aktiven Recherchepartner nutzt.

Modus 3: Mensch definiert Methodik, Agent skaliert sie

Das ist der Modus, der am meisten unterschätzt wird. Ein Senior-Analyst entwickelt eine Methodik für Wettbewerbsanalysen: welche Quellen, welche Kriterien, welche Struktur. Diese Methodik wird in ein ausführbares Template überführt. Ab diesem Moment kann jeder im Team dieselbe Analyse in derselben Qualität durchführen, weil die Methodik nicht im Kopf des Analysten steckt, sondern im System.

Das löst eines der hartnäckigsten Probleme in Professional-Services-Firmen: Wenn ein erfahrener Analyst das Unternehmen verlässt, geht seine Methodik mit. Mit definierten Playbooks bleibt das Wissen in der Organisation. Der Agent führt aus, was der Mensch einmal definiert hat, und der nächste Analyst baut darauf auf statt bei null anzufangen.

Was passiert, wenn Mensch und KI ihre Rollen tauschen

Interessant ist, was die Forschung zu den Grenzen sagt. Eine Studie in Scientific Reports zeigt: Mensch-KI-Zusammenarbeit verbessert die Aufgabenleistung, kann aber die intrinsische Motivation senken, besonders bei weniger erfahrenen Mitarbeiter*Innen. Wer sich darauf verlässt, dass die KI die Arbeit macht, verlernt, selbst zu denken.

Das spricht nicht gegen Zusammenarbeit, sondern für eine klare Rollenverteilung. Wenn der Analyst nur noch auf "Bestätigen" klickt, ist das Abnicken, keine Kollaboration. Wenn der Analyst die Ergebnisse kritisch prüft, eigene Hypothesen formuliert und dem Agenten gezielte Rückfragen stellt, entsteht tatsächlich etwas Besseres als die Summe der Teile.

Carnegie Mellon University forscht genau daran: Wie KI menschliche Zusammenarbeit stärken kann statt sie zu ersetzen. Ihre Erkenntnis: KI funktioniert am besten in einer Partnerrolle oder als Facilitator, nicht als Vorgesetzter, der Entscheidungen trifft.

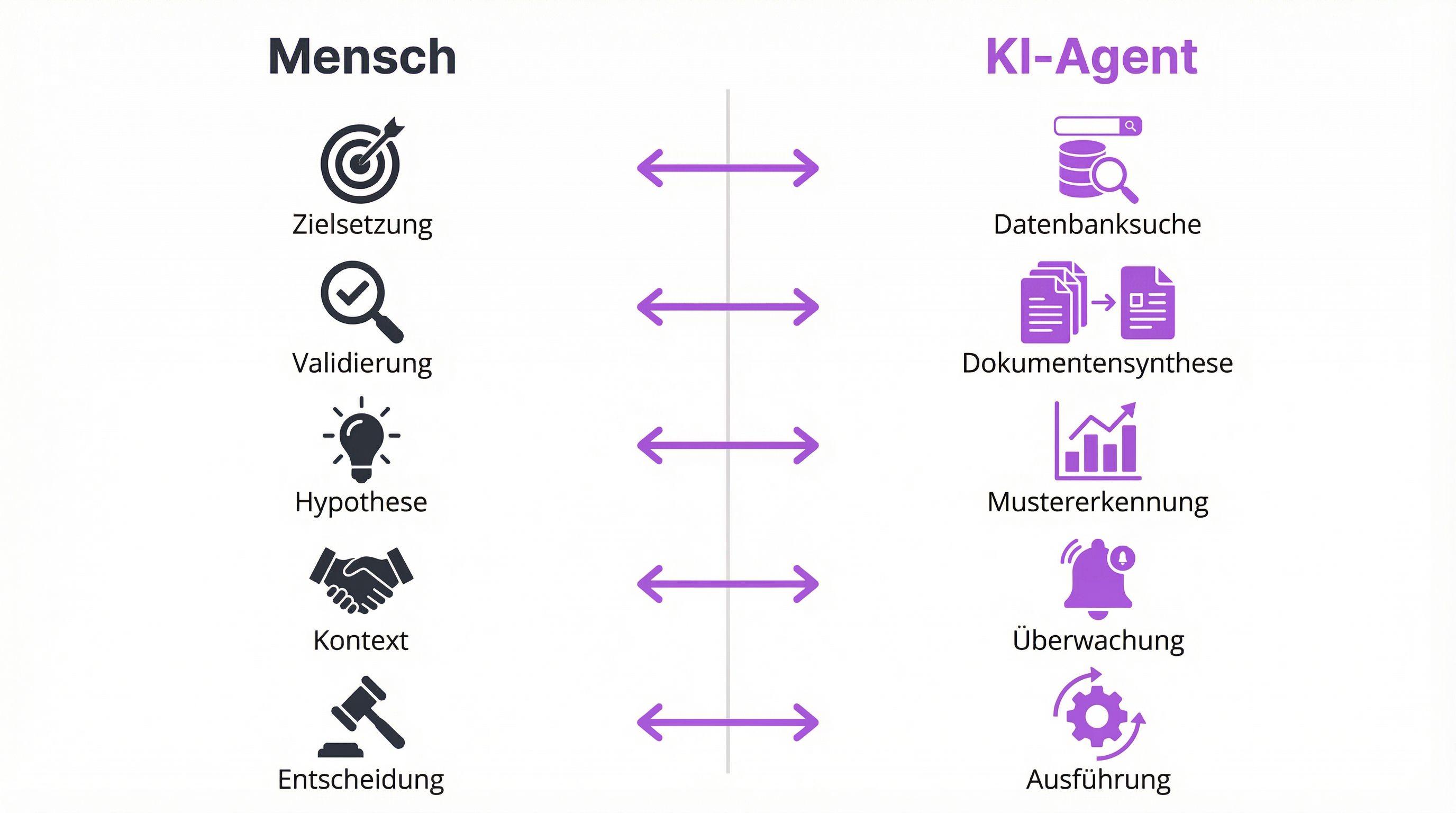

Die praktische Konsequenz für Analyseteams:

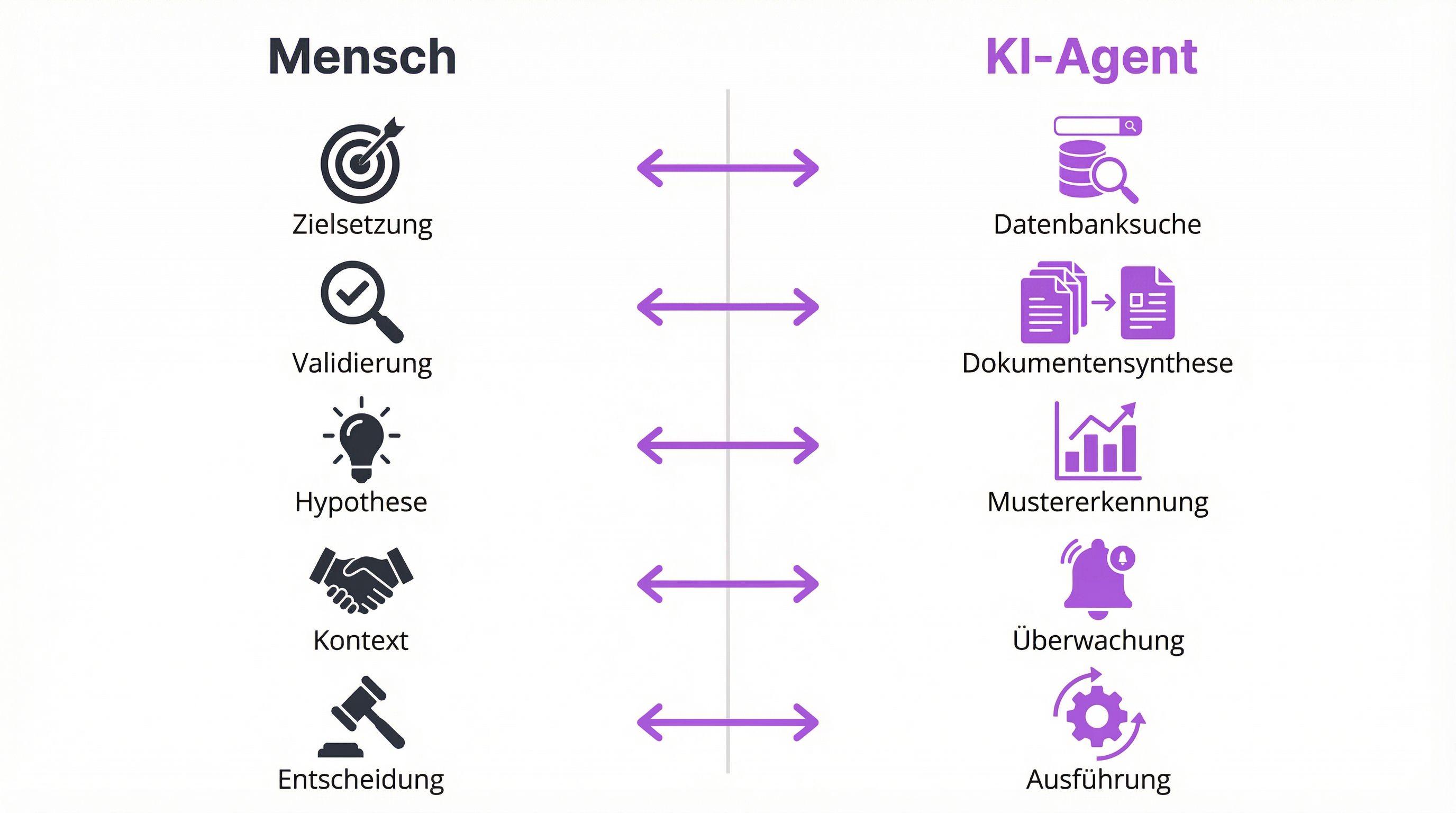

| Der Mensch sollte | Die KI sollte |

|---|---|

| Rechercheziele definieren | Datenquellen systematisch durchsuchen |

| Ergebnisse bewerten und interpretieren | Informationen synthetisieren und strukturieren |

| Hypothesen formulieren | Hypothesen gegen Daten prüfen |

| Kontext der Organisation einbringen | Muster und Anomalien erkennen |

| Entscheidungen treffen und verteidigen | Kontinuierlich relevante Signale überwachen |

| Methodik entwickeln und verfeinern | Methodik wiederholbar ausführen |

Welche Fähigkeiten Analyst*Innen für die Zusammenarbeit mit KI brauchen

Der WEF schätzt, dass 77% der Arbeitgeber zwischen 2025 und 2030 in KI-Upskilling investieren werden. Aber welche Fähigkeiten sind das konkret? Für Analyst*Innen in der strategischen Recherche sind es drei:

Promptgesteuerte Auftragserteilung. Nicht im Sinne von "bessere Prompts schreiben". Sondern im Sinne von: ein Rechercheziel so formulieren, dass ein Agent es in ausführbare Schritte zerlegen kann. Das erfordert, den eigenen Rechercheprozess explizit zu machen, was die meisten Analysten nie mussten. Wer seinen Prozess nicht beschreiben kann, kann ihn nicht delegieren.

Ergebnisvalidierung. KI-Agenten liefern quellenattribuierte Ergebnisse, aber "quellenattribuiert" heißt nicht "korrekt". Die Fähigkeit, eine KI-generierte Analyse kritisch zu prüfen, Lücken zu erkennen und Verzerrungen zu identifizieren, wird zur Kernkompetenz. Das ist anspruchsvoller als die Recherche selbst, weil man die Ergebnisse eines Systems bewerten muss, dessen Denkweg man nicht vollständig nachvollziehen kann.

Methodik-Design. In einer Welt, in der KI-Agenten Analysen ausführen, wird die Qualität der Methodik zum Differenzierungsmerkmal. Der beste Analyst ist nicht mehr der, der am schnellsten recherchiert, sondern der, der die beste Methodik entwirft, diese systematisch testet und kontinuierlich verbessert.

Was die meisten Unternehmen falsch machen

BCG hat den Begriff "Silicon Ceiling" geprägt: Nur die Hälfte der Frontline-Mitarbeiter*Innen nutzt KI-Tools regelmäßig. Das liegt nicht an mangelndem Zugang, sondern an drei Faktoren:

Erstens behandeln die meisten Unternehmen KI als Tool-Rollout statt als Veränderung der Arbeitsweise. Sie kaufen Lizenzen und erwarten, dass die Produktivität steigt. Aber ein KI-Agent ist kein schnellerer Browser. Er verändert, wer welche Arbeit macht, und das erfordert neue Prozesse, nicht nur neue Software.

Zweitens fehlt die Methodik-Schicht. Ohne definierte Workflows weiß niemand, welche Aufgaben der Agent übernehmen soll und welche beim Menschen bleiben. Das Ergebnis: Analyst*Innen experimentieren auf eigene Faust, jeder macht es anders, niemand skaliert.

Drittens messen Unternehmen den Erfolg falsch. "Wir haben ChatGPT-Lizenzen ausgerollt" ist keine KI-Strategie. Die relevante Metrik ist: Wie viel Analysten-Zeit fließt in Informationsbeschaffung versus Interpretation? Wenn sich das Verhältnis nicht verschiebt, hat die KI-Investition nichts verändert.

Von der Theorie zum System: Mensch-KI-Zusammenarbeit operationalisieren

Researchly setzt die drei Kollaborationsmodi direkt um. Nicht als Konzept, sondern als laufendes System für Analyseteams.

Recherche delegieren statt selbst suchen. KI-Agenten greifen auf über 100 Datenquellen zu, von Patentdatenbanken über Startup-Tracker bis zu regulatorischen Registern. Der Analyst definiert das Ziel, der Agent liefert das Ergebnis, quellenattribuiert und in der Struktur, die das Team braucht.

Methodiken festhalten statt verlieren. Der Template Builder macht Research-Playbooks ausführbar. Eine einmal definierte Wettbewerbsanalyse-Methodik kann jedes Teammitglied nutzen, nicht nur die Person, die sie entwickelt hat. Das Wissen bleibt in der Organisation.

Signale überwachen statt periodisch suchen. Kontinuierliches Monitoring von Patenten, Funding-Runden, regulatorischen Änderungen und Wettbewerber-Aktivitäten. Der Agent alertet, wenn etwas für den Kontext des Analyseteams relevant ist.

Die drei Outputs, die Analyseteams erhalten:

- Quellenattribuierte Recherche-Ergebnisse in Minuten statt Tagen

- Wiederholbare Analyse-Playbooks, die unabhängig vom Durchführenden funktionieren

- Kontextuelles Monitoring, das relevante Signale aus dem Rauschen filtert

Das ist Mensch-KI-Zusammenarbeit, wie sie für Analyseteams tatsächlich funktioniert. Kein HR-Slogan, sondern ein operatives System.