Die meisten Wettbewerbsanalysen scheitern nicht an der Methode. Sie scheitern daran, dass sie auf der falschen Ebene ansetzen. SWOT-Analysen, PESTEL-Frameworks, Five-Forces-Modelle: alles strategische Instrumente. Aber wenn ein Product Manager wissen will, ob der Konkurrent eine native API hat, oder ein VC verstehen will, ob das Feature Set eines Targets verteidigbar ist, helfen strategische Frameworks nicht weiter.

Ein Produkt-Feature-Vergleich arbeitet auf der Ebene, die tatsächlich zählt: dem Produkt selbst. Welche Funktionen existieren bei welchem Wettbewerber? Was ist Standard, was differenziert? Wo gibt es Lücken, die niemand füllt?

Klingt simpel. Bei 5 Wettbewerbern ist es das auch. Bei 30 oder 50 wird es ein Projekt, das Wochen dauert und veraltet ist, bevor die Ergebnisse in einer Präsentation landen. Genau da liegt die Chance.

Was ein Produkt-Feature-Vergleich ist (und was nicht)

Ein Produkt-Feature-Vergleich erfasst systematisch, welche konkreten Funktionen die Produkte in einem Markt bieten. Das Ergebnis ist eine Feature Matrix: eine Tabelle, in der Wettbewerber die Spalten und Produktfunktionen die Zeilen bilden.

Der Unterschied zu anderen Analyse-Frameworks:

| Methode | Analyseebene | Kernfrage | Ergebnis |

|---|---|---|---|

| SWOT-Analyse | Strategisch | Stärken und Schwächen? | Strategische Einschätzung |

| PESTEL-Analyse | Makro-Umfeld | Welche externen Faktoren wirken? | Umfeldbewertung |

| Five Forces | Marktstruktur | Wie intensiv ist der Wettbewerb? | Branchenattraktivität |

| Feature-Vergleich | Produkt | Wer kann was? | Feature Matrix |

SWOT beantwortet "Wie steht das Unternehmen da?". Der Feature-Vergleich beantwortet "Was kann das Produkt im Vergleich?". Beides ist nützlich. Aber es sind unterschiedliche Fragen, und die Antwort auf die eine ersetzt nicht die andere.

Wann Sie einen Feature-Vergleich brauchen

Fünf Situationen, in denen eine Feature Matrix mehr liefert als eine strategische Analyse:

Roadmap-Priorisierung. Ihr Product Team diskutiert, welches Feature als nächstes gebaut werden soll. Die Feature Matrix zeigt, was Table Stakes sind (alle Wettbewerber haben es, Sie brauchen es auch), was differenziert (nur 2 von 20 haben es), und was niemand hat (Lücke im Markt, potenzielle Innovation).

Investment-Entscheidung. Ein VC prüft, ob ein Startup-Produkt im Wettbewerbsvergleich besteht. Hat das Target ein vollständigeres Feature Set als die Konkurrenz? Oder fehlen Basisfunktionen, die der Markt erwartet? Das ist ein zentraler Datenpunkt für das Investment Memo.

Commercial Due Diligence. PE-Teams bewerten die Wettbewerbspositionierung eines Targets. Die Feature Matrix ist der empirische Teil der Produktbewertung: nicht "wir glauben, das Produkt ist gut", sondern "hier ist, wie es sich Feature für Feature gegen den Markt schlägt". BCG beschreibt diesen Produktvergleich als einen der sechs zentralen Bausteine einer Technology Due Diligence.

Beratungsprojekt. Ein Consultant liefert dem Klienten eine Wettbewerbsanalyse. Statt allgemeiner Einschätzungen liefert die Feature Matrix ein konkretes, datengestütztes Deliverable: "Ihr Produkt hat 23 von 30 Marktstandard-Features. In diesen 4 Bereichen sind Sie Marktführer. In diesen 3 fehlt Ihnen eine Basisfunktion."

Build-vs-Buy. Ein Unternehmen entscheidet, ob es eine Funktion selbst baut oder einen Anbieter kauft. Die Feature Matrix zeigt, welche bestehenden Lösungen den Bedarf bereits abdecken und wo die Eigenentwicklung einen tatsächlichen Vorsprung schaffen würde.

Feature-Vergleich erstellen: die 5-Schritte-Methode

Schritt 1: Wettbewerber identifizieren und segmentieren

Bevor Sie Features vergleichen, definieren Sie, wen Sie vergleichen. Drei Kategorien:

- Direkte Wettbewerber lösen dasselbe Problem für dieselbe Zielgruppe

- Indirekte Wettbewerber lösen das Problem anders (z.B. Spreadsheet statt SaaS-Tool)

- Emerging Players sind neu im Markt und verändern die Feature-Erwartungen

Wie viele? Das hängt vom Zweck ab:

| Anwendungsfall | Empfohlene Anzahl |

|---|---|

| Due Diligence | 5-8 (Tiefe vor Breite) |

| Roadmap-Entscheidung | 10-15 |

| Marktüberblick / Startup Landscape | 30-50 |

Häufiger Fehler: nur die bekannten Top-5 vergleichen und die 15 Newcomer ignorieren, die gerade Features liefern, die Ihr Klient oder Ihr Portfolio-Unternehmen nicht auf dem Radar hat.

Schritt 2: Feature-Kategorien definieren

Definieren Sie zuerst die Kategorien, nicht die einzelnen Features. Das schafft Struktur und verhindert, dass Sie sich in Details verlieren, bevor das Gesamtbild steht.

Beispiel-Kategorien für ein B2B-SaaS-Produkt:

| Kategorie | Was Sie erfassen |

|---|---|

| Kernfunktionalität | Die Basisfunktionen, die das Produkt ausmachen |

| Integrationen | Welche Drittsysteme angebunden sind |

| Analytics & Reporting | Dashboard, Export, Custom Reports |

| Collaboration | Multi-User, Rollen, Kommentare |

| Security & Compliance | SSO, SOC 2, DSGVO |

| API & Erweiterbarkeit | REST API, Webhooks, Marketplace |

| Pricing-Modell | Freemium, Seat-basiert, Usage-basiert |

Der Fehler, den ich am häufigsten sehe: Teams starten mit ihrer eigenen Feature-Liste als Referenz. Das verzerrt die Analyse, weil Sie unbewusst Kategorien bevorzugen, in denen Sie stark sind. Starten Sie stattdessen mit dem Job-to-be-Done des Kunden. Was will der Nutzer erreichen? Welche Funktionen braucht er dafür?

Wer Feature-Vergleiche regelmäßig durchführt, ob für verschiedene Märkte, verschiedene Portfolio-Unternehmen oder wiederkehrende Beratungsprojekte, sollte eine standardisierte Taxonomie aufbauen. Ein festes Kategorie-Raster (z.B. immer dieselben 8-10 Oberkategorien, branchenspezifisch angepasst in den Unterkategorien) macht Vergleiche über Zeit und über Märkte hinweg konsistent. Ohne Taxonomie vergleichen Sie Äpfel mit Birnen, weil jeder Analyst die Kategorien anders schneidet. Mit Taxonomie wird jeder neue Feature-Vergleich sofort vergleichbar mit den vorherigen.

Schritt 3: Daten erheben

Hier wird es aufwändig. Und hier scheitern die meisten Feature-Vergleiche in der Praxis.

Manuelle Erhebung (funktioniert bei 5-10 Wettbewerbern):

- Produktseiten und Feature-Listen der Wettbewerber durchgehen

- G2, Capterra und Trustpilot Reviews nach Feature-Erwähnungen durchsuchen

- Dokumentation und API-Referenzen prüfen

- Wenn möglich: Free Trials testen

Das Problem mit manueller Erhebung: Laut Crayons State of Competitive Intelligence Report 2025 geben 58% der CI-Teams an, dass sie Schwierigkeiten haben, ihre Wettbewerbsinformationen aktuell zu halten. Die Daten sind veraltet, bevor die Analyse fertig ist. Und bei 20 oder mehr Wettbewerbern reden wir von Wochen an Analyst*Innen-Zeit.

KI-gestützte Erhebung (notwendig ab 15-20 Wettbewerbern):

- Automatisiertes Crawling von Produktseiten und Feature-Listen

- Strukturierte Extraktion: welche Features werden erwähnt, in welcher Tiefe

- Normalisierung: "Kanban Board", "Board View" und "Task Board" als dasselbe Feature erkennen

Für 5 Wettbewerber reicht ein Nachmittag und eine Excel-Tabelle. Ab 20 wird es ohne Automatisierung unpraktikabel.

Schritt 4: Feature Matrix aufbauen

Jetzt tragen Sie die Ergebnisse zusammen. Die Tabelle ist das Kernstück der Analyse.

Ein Beispiel aus dem Projektmanagement-Markt (vereinfacht):

| Feature | Asana | Monday | ClickUp | Jira | Notion | Linear |

|---|---|---|---|---|---|---|

| Kanban Board | Ja | Ja | Ja | Ja | Ja | Ja |

| Gantt Charts | Ja | Ja | Ja | Ja (Plugin) | Nein | Nein |

| Native Zeiterfassung | Nein | Ja | Ja | Nein | Nein | Nein |

| Resource Management | Ja | Ja | Ja | Nein | Nein | Nein |

| AI Task Suggestions | Ja | Ja | Ja | Ja | Ja | Nein |

| Custom Workflows | Ja | Ja | Ja | Ja | Eingeschränkt | Ja |

| REST API | Ja | Ja | Ja | Ja | Ja | Ja |

| SOC 2 Zertifizierung | Ja | Ja | Ja | Ja | Ja | Ja |

| Freemium-Plan | Ja | Nein | Ja | Ja | Ja | Nein |

Eine alternative Darstellung geht über Ja/Nein hinaus und erfasst, wie jeder Wettbewerber ein Feature umsetzt. Das ist aufwändiger, liefert aber deutlich mehr Substanz, gerade für Roadmap-Entscheidungen und Due Diligence:

| Feature | Startup A (The Optimizer) | Startup B (The Automator) | Startup C (The Invisible UI) | Trend-Stärke |

|---|---|---|---|---|

| Autonomous Scheduling | AI reshuffles Tasks nach Urgency/Meetings | Statischer manueller Input | "Deep Work"-Blöcke, auto-assigned | HIGH |

| Natural Language Entry | "Remind me to call John on Friday" erstellt Task | Slash-Command-System (/task) | Voice-to-Task-Integration | CRITICAL |

| Auto-Documentation | Zeichnet Meetings auf, aktualisiert Task-Status | Fasst lange Comment Threads in Action Items zusammen | Generiert PRDs aus Chat-Verläufen | EMERGING |

| Multiplayer Sync | Instant CRDT Sync, sub-100ms, kein Lag | Standard Cloud Sync | Local-first Architektur, Offline Mode | STANDARD |

Der Unterschied: Die Ja/Nein-Matrix beantwortet "Wer hat was?". Die qualitative Matrix beantwortet "Wer löst es wie?". Für einen Product Manager, der die eigene Roadmap priorisiert, ist die zweite Variante wertvoller, weil sie zeigt, welche Implementierung der Markt belohnt. Für einen Investor reicht oft die Ja/Nein-Matrix als erster Filter, bevor man in die Tiefe geht.

Die Spalte "Trend-Stärke" fügt eine zusätzliche Dimension hinzu: Wie schnell wird dieses Feature zum Standard? CRITICAL bedeutet, ohne dieses Feature verlieren Sie heute Deals. EMERGING bedeutet, die ersten bewegen sich, der Rest hat 12-18 Monate Reaktionszeit.

Was die einfache Matrix sofort zeigt:

- Table Stakes (alle haben es): Kanban, API, SOC 2. Wenn Ihr Produkt das nicht hat, haben Sie ein Problem.

- Emerging Standard (Mehrheit hat es): AI Task Suggestions. Vor zwei Jahren hatte das niemand, jetzt 5 von 6. Wird zum Table Stake.

- Differenzierend (wenige haben es): Native Zeiterfassung (2 von 6), Resource Management (3 von 6). Hier entsteht Wettbewerbsvorteil.

- Lücke (niemand hat es gut gelöst): In diesem vereinfachten Beispiel nicht sichtbar, aber in einer echten Matrix mit 30 Features und 20 Wettbewerbern tauchen immer 2-3 Lücken auf.

Schritt 5: Insights ableiten

Die Matrix ist nur die halbe Arbeit. Der Wert liegt in der Interpretation. Und die fällt je nach Rolle unterschiedlich aus:

Als Product Manager lesen Sie die Matrix als Roadmap-Input. Table Stakes, die Ihnen fehlen, haben höchste Priorität (Kund*Innen erwarten sie). Emerging Standards sind mittelfristige Pflicht. Differenzierende Features sind Ihre Chance, wenn Sie schnell genug sind. Lücken sind potenzielle Innovationsprojekte.

Als VC oder PE-Investor lesen Sie die Matrix als Bewertungsinstrument. Ein Target mit überdurchschnittlichem Feature Coverage hat einen stärkeren Moat. Ein Target, dem Table Stakes fehlen, braucht Post-Investment-Kapital für Catch-up statt für Wachstum. Das verändert die Bewertung. Dieser Datenpunkt gehört in die Commercial Due Diligence und ins Investment Memo.

Als Berater*In liefern Sie die Matrix als Deliverable. Kein Klient beschwert sich über eine Tabelle, die zeigt: "Ihr Produkt deckt 23 von 30 Features ab, der Marktführer 28, der gefährlichste Newcomer 19, aber mit AI-Native-Ansatz." Das ist konkreter als jede SWOT-Einschätzung.

Praxis-Beispiel: Feature-Vergleich im Projektmanagement-Markt

Nehmen wir an, ein PE-Fonds prüft eine Akquisition im Projektmanagement-Segment. Das Target hat ein solides Produkt, aber die Frage ist: Wie defensiv ist die Position?

Die Feature Matrix mit 6 Wettbewerbern (s. oben) zeigt auf einen Blick:

1. Das Target hat Parity in den Table Stakes. Kanban, API, Security: alles da. Kein Aufholbedarf bei Basisfunktionen.

2. Das Target hat zwei Differenzierungsmerkmale: Native Zeiterfassung und Resource Management. Nur 2 bzw. 3 von 6 Wettbewerbern bieten das. Das spricht für eine stärkere Position bei Mid-Market-Kund*Innen, die All-in-One-Lösungen bevorzugen.

3. AI Features sind kein Differenzierungsmerkmal mehr. 5 von 6 Tools haben AI Task Suggestions. Wer das als Unique Selling Point verkauft, liegt falsch. Es ist bereits Table Stake.

4. Pricing-Modell als strategischer Hebel. Nur 4 von 6 bieten Freemium. Das Target hat kein Freemium. Das könnte ein Risiko sein (weniger Top-of-Funnel) oder eine bewusste Entscheidung (höherer ARPU). Die Matrix liefert den Datenpunkt, die Interpretation erfordert Kontext.

Diese Analyse dauert manuell 2-3 Wochen für einen gründlichen Vergleich. Mit KI-gestützten Analyse-Tools sind die Rohdaten in unter einer Stunde erhoben, die Interpretation bleibt beim Analysten.

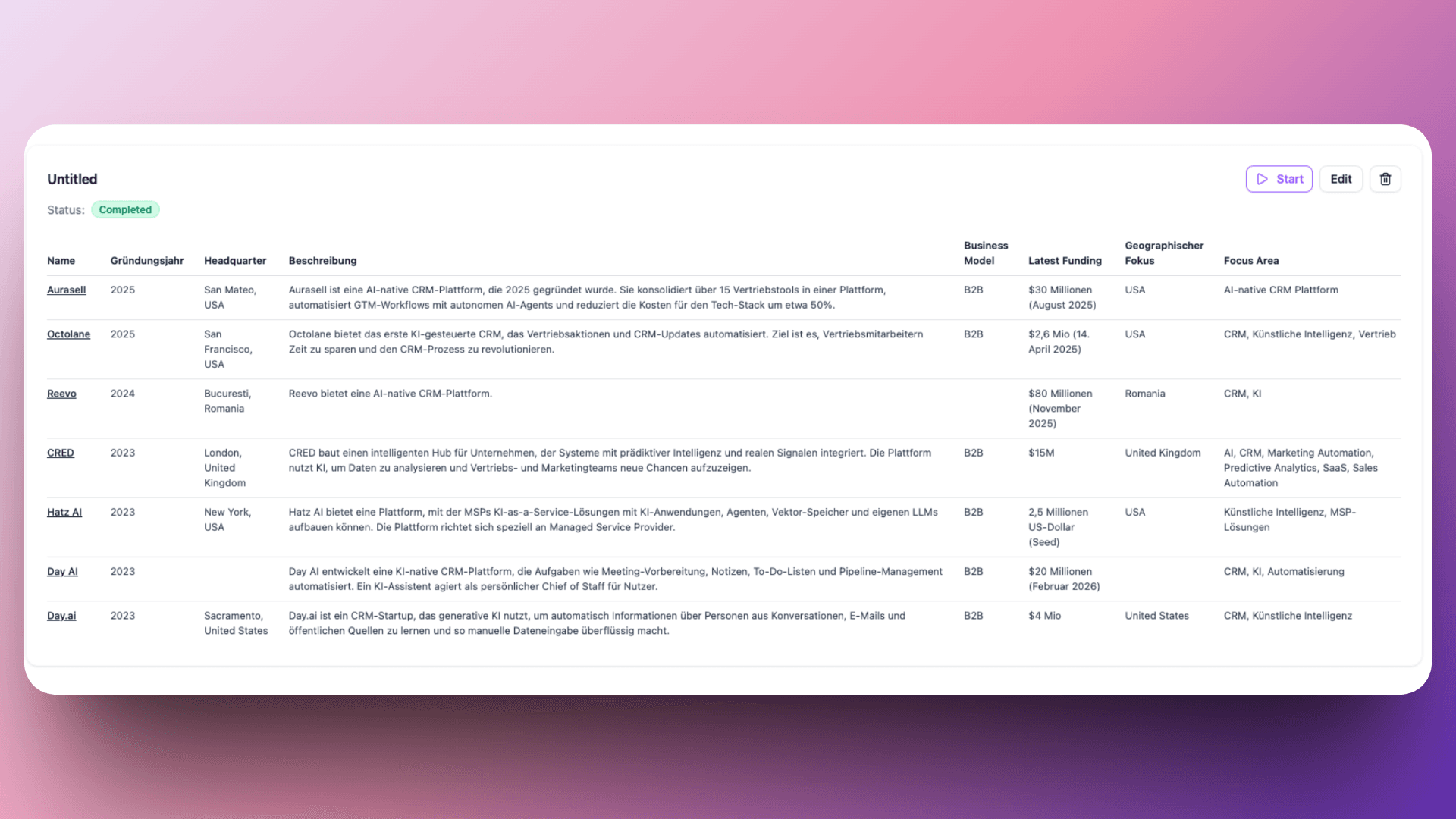

Praxis-Beispiel: AI-native CRM-Startups im Feature-Vergleich (mit Researchly)

Das Projektmanagement-Beispiel oben ist illustrativ. Hier ein realer Feature-Vergleich, den wir mit Researchly durchgeführt haben: AI-native CRM-Startups, gegründet zwischen 2023 und 2025.

Die Ausgangsfrage: Ein Investor will verstehen, wie sich die neue Generation von CRM-Startups (Aurasell, Octolane, Reevo, Day.ai) von klassischen Anbietern unterscheidet und welche Feature-Patterns sich abzeichnen. Researchly hat die Startups identifiziert, Produktseiten gescannt und eine Feature Matrix mit über 30 Kategorien aufgebaut.

Schritt 1: Startups identifizieren mit unserer Startup Suche

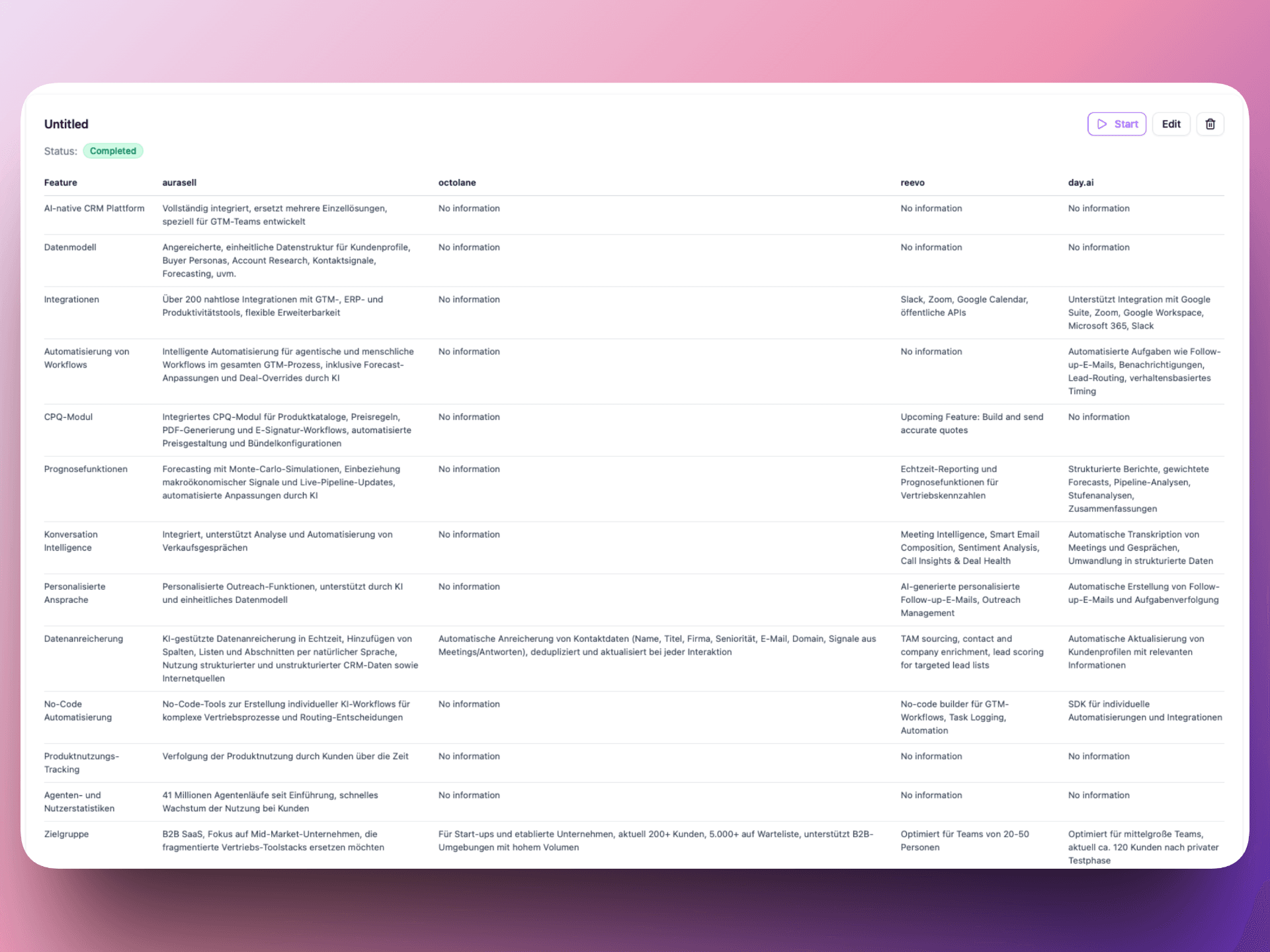

Schritt 2: Feature Matrix analysieren

Ein Ausschnitt aus der Matrix:

| Feature | Aurasell | Octolane | Reevo | Day.ai |

|---|---|---|---|---|

| Datenanreicherung | KI-gestützt in Echtzeit, natürliche Sprache, strukturierte + unstrukturierte Quellen | Automatisch aus Meetings und Antworten, dedupliziert bei jeder Interaktion | TAM Sourcing, Contact & Company Enrichment, Lead Scoring | Automatische Profilaktualisierung aus Gesprächen |

| Workflow-Automatisierung | Agentische + menschliche Workflows im GTM-Prozess, inkl. Forecast-Overrides durch KI | Automatisiert Follow-ups, Pipeline-Updates, Outreach, Demo-Terminierung | No-Code Builder für GTM-Workflows | Follow-up-E-Mails, Lead-Routing, verhaltensbasiertes Timing |

| Prognosefunktionen | Monte-Carlo-Simulationen, makroökonomische Signale, Live-Pipeline-Updates | Detaillierte Analysen und Prognosen | Echtzeit-Reporting für Vertriebskennzahlen | Gewichtete Forecasts, Pipeline- und Stufenanalysen |

| Conversation Intelligence | Integriert, Analyse von Verkaufsgesprächen | Keine Information | Meeting Intelligence, Sentiment Analysis, Call Insights | Automatische Transkription, Umwandlung in strukturierte Daten |

| Proaktive Aktionen | Keine Information | Erkennt verpasste Chancen und Buyer Signals automatisch | Liefert proaktiv Kontext und Handlungsempfehlungen | CRM als "System of Action" statt passiver Datenhaltung |

| Voice Dialer | KI-nativer Voice Dialer integriert | Keine Information | Integrated Dialer | Keine Information |

| Preisstruktur | Keine Information | Free bis $1.000/Monat, unbegrenzte Seats ab Business-Tarif | Core, Pro, Enterprise, 50% Startup-Rabatt | Individuelle Preisgestaltung |

Das sind echte Daten von echten Produktseiten, keine hypothetischen Ja/Nein-Einträge. Und genau hier zeigt sich der Unterschied zwischen einer generischen Wettbewerbsanalyse und einem Feature-Vergleich auf Produktebene.

Was die Matrix zeigt: drei Patterns, die den CRM-Markt verändern

Aus der vollständigen Matrix mit über 30 Features lassen sich drei Muster ableiten, die ein Investor oder Product Manager kennen sollte:

Pattern 1: Das "Zero-Entry" CRM. Die manuelle Dateneingabe, seit Jahrzehnten der größte Schmerzpunkt bei CRM-Nutzung, wird abgeschafft. Day.ai lernt automatisch aus E-Mails und öffentlichen Quellen. Octolane reichert Kontaktdaten aus Meetings und Antworten an, ohne dass jemand ein Feld ausfüllt. Das CRM wandelt sich vom manuellen "System of Record" zum autonomen System, das sich selbst befüllt.

Pattern 2: Stack-Konsolidierung. Die neuen Anbieter positionieren sich als Ersatz für fragmentierte Tool-Stacks. Aurasell konsolidiert laut eigener Aussage über 15 Vertriebstools in einer Plattform und senkt die Stack-Kosten um 50%. Reevo und Day.ai integrieren Meeting Intelligence, Dialer und Wissensdatenbank, Funktionen, die bisher eigenständige Produkte waren. Der Trend geht weg von Micro-SaaS und zurück zu Plattformen, bei denen KI die Klammer zwischen Marketing, Vertrieb und Customer Success bildet.

Pattern 3: Agentische Workflows. Software meldet sich proaktiv, statt auf Input zu warten. Day.ai hat einen Assistenten, der Meetings vorbereitet und To-do-Listen pflegt. Aurasell setzt autonome AI Agents für GTM-Workflows ein. Octolane erkennt verpasste Chancen und Buyer Signals automatisch. Die Arbeit wird nicht mehr vom Nutzer am Dashboard gesteuert, sondern das System identifiziert, was getan werden muss, und handelt entweder selbst oder liefert den Kontext für die menschliche Entscheidung.

Was ein Investor daraus mitnimmt

Diese drei Patterns sind keine Randerscheinungen. Alle analysierten Startups (gegründet 2023-2025, Funding zwischen $2,5M und $80M) setzen auf AI-native Architektur. Monte-Carlo-Simulationen für Forecasting, Datenanreicherung per natürlicher Sprache, proaktive Aktionen: das waren vor drei Jahren Differenzierungsmerkmale. Jetzt bauen es alle neuen Anbieter von Tag eins ein.

Für einen VC, der ein CRM-Investment prüft, heißt das konkret: Ein Target, das 2026 noch manuelle Dateneingabe voraussetzt, hat ein Architekturproblem, nicht nur ein Feature-Problem. Die Feature Matrix macht das sichtbar, bevor es im Umsatz sichtbar wird.

Feature-Trends als Signal lesen

Ein Feature-Vergleich ist ein Snapshot. Er zeigt den Markt zu einem bestimmten Zeitpunkt. Aber der eigentliche Wert entsteht, wenn Sie den Vergleich über Zeit wiederholen.

Wenn AI Task Suggestions vor 12 Monaten bei 1 von 6 Tools vorhanden waren und heute bei 5 von 6, ist das ein klares Signal: Die Funktion wandert vom Differenzierungsmerkmal zum Table Stake. Wer sie in 6 Monaten noch nicht hat, verliert Deals.

Gartner stuft Competitive und Market Intelligence als Top-Priorität ein: 74% der befragten Tech-Marketer nannten es als prioritär für die nächsten 12 Monate. Feature-Trends sind der konkreteste Ausdruck dieser Intelligence.

Für Investoren ist das besonders relevant. Ein Trendradar auf Feature-Ebene zeigt, wohin sich ein Markt bewegt, bevor es in den Quartalsberichten steht. Welche Features tauchen bei Early-Stage-Startups auf, die es bei den Incumbents noch nicht gibt? Das sind die Signale, die Trend-Scouting-Teams suchen.

Die Grenzen des Feature-Vergleichs

Ein Feature-Vergleich hat blinde Flecken. Es wäre unehrlich, das zu verschweigen.

Features sind nicht gleich Product Quality. Zwei Tools können beide "Gantt Charts" haben, aber die Implementierung kann Welten auseinander liegen. Die Matrix zeigt, ob ein Feature existiert. Nicht, wie gut es umgesetzt ist.

Kund*Innen kaufen nicht nach Features. Buying Decisions hängen von Marke, Switching Costs, Ecosystem Lock-in und Empfehlungen ab. Ein Feature-Vergleich allein erklärt nicht, warum Salesforce Deals gewinnt, obwohl das Feature Set nicht in jeder Kategorie führend ist.

Der Vergleich veraltet schnell. In schnell wachsenden Märkten sind die Daten nach 3-6 Monaten überholt. Ein einmaliger Vergleich ist nützlich, aber kein Ersatz für kontinuierliches Monitoring.

Der Feature-Vergleich ist deshalb am stärksten, wenn er mit strategischen Frameworks kombiniert wird. Die Feature Matrix liefert die Produktdaten. Die SWOT-Analyse liefert die strategische Einordnung. Die Marktanalyse liefert den Kontext.

Manuell vs. KI-gestützt: was sich wann lohnt

| Dimension | Manuell (Excel + Recherche) | KI-gestützt |

|---|---|---|

| Zeitaufwand (20 Wettbewerber) | 2-4 Wochen | 30-60 Minuten (Datenerhebung) |

| Skalierbarkeit | Maximal 10-15 realistisch | 50+ ohne Qualitätsverlust |

| Aktualität | Snapshot, veraltet nach 3 Monaten | Wiederholbar, regelmäßig aktualisierbar |

| Konsistenz | Abhängig vom Analysten | Strukturiert nach definiertem Schema |

| Tiefe | Hoch bei wenigen Wettbewerbern | Breit bei vielen, tief bei ausgewählten |

| Kosten | Analyst*Innen-Zeit (300-600 EUR/Tag) | Tool-Kosten (Bruchteil pro Vergleich) |

Die Rechnung ist einfach: Ein Junior Analyst braucht 2-3 Wochen für einen gründlichen Feature-Vergleich mit 20 Wettbewerbern. Das sind 10-15 Arbeitstage, also 3.000-9.000 EUR Personalkosten, je nach Tagessatz. Und das Ergebnis ist ein einmaliger Snapshot.

Für einen VC, der 10 Deals pro Quartal prüft, ist das nicht skalierbar. Für eine Beratung, die den Vergleich als Deliverable verkauft, frisst die manuelle Erhebung die Marge.

Vom Einzelvergleich zum systematischen Monitoring

Ein einmaliger Feature-Vergleich beantwortet die Frage für heute. Aber Märkte bewegen sich. Features, die heute differenzieren, sind morgen Standard. Newcomer tauchen auf und verändern die Erwartungen. Wer seinen Feature-Vergleich einmal pro Jahr aktualisiert, verpasst die Signale, die zählen.

Researchly unterstützt VC-Teams, PE-Firmen und Strategie-Abteilungen dabei, genau diesen Schritt zu machen: vom einmaligen Feature-Vergleich zum kontinuierlichen Produkt-Monitoring. Die Plattform scannt Wettbewerber systematisch, extrahiert Feature-Informationen und macht Veränderungen über Zeit sichtbar.

Was Sie damit erhalten:

- Feature Matrix für 20-50 Wettbewerber in unter einer Stunde statt in Wochen

- Automatische Erkennung von Feature-Trends: was wird zum neuen Standard, was verschwindet

- Vergleichbare Snapshots über Zeit, die zeigen, wie sich die Wettbewerbsposition Ihres Portfolios oder Klienten verändert